IA e deepfake: Meloni denuncia foto false in sottoveste

Si riapre il dibattito su privacy, reputazione e nuove regole digitali in Italia e in Europa.

Il confine tra realtà e manipolazione digitale si fa sempre più sottile, e il caso che coinvolge la presidente del Consiglio riporta al centro dell’attenzione pubblica uno dei temi più urgenti dell’era contemporanea: l’uso dell’intelligenza artificiale per creare contenuti falsi ma credibili, capaci di circolare rapidamente sui social e di incidere sull’immagine delle persone.

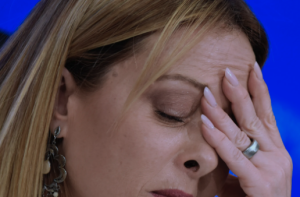

La protagonista della vicenda è Giorgia Meloni, che ha denunciato la diffusione online di immagini false generate con sistemi di intelligenza artificiale, raffiguranti la premier in contesti privati e non reali, tra cui fotografie manipolate che la ritrarrebbero in sottoveste. Un episodio che ha immediatamente acceso il dibattito politico, mediatico e giuridico.

Il caso riapre una questione cruciale: quanto è vulnerabile oggi la reputazione pubblica nell’era dei deepfake?

La denuncia e il caso delle immagini generate con IA

Secondo quanto emerso, le immagini circolate sui social network sarebbero state create tramite strumenti di intelligenza artificiale generativa, capaci di produrre contenuti visivi estremamente realistici partendo da fotografie reali o da descrizioni testuali.

Nel caso specifico, le immagini avrebbero raffigurato la premier in situazioni private mai avvenute, alimentando una narrazione completamente artificiale ma visivamente convincente.

La diffusione di contenuti di questo tipo rappresenta una nuova frontiera della disinformazione digitale, in cui la falsificazione non riguarda più solo testi o audio, ma anche immagini fotorealistiche difficilmente distinguibili dalla realtà.

La denuncia punta l’attenzione non solo sugli autori della manipolazione, ma anche sulle piattaforme attraverso cui i contenuti sono stati diffusi e amplificati.

Cosa sono i deepfake e perché preoccupano

I cosiddetti deepfake sono contenuti multimediali generati o modificati attraverso algoritmi di intelligenza artificiale, in grado di replicare volti, voci e movimenti con un alto grado di realismo.

Questa tecnologia, nata inizialmente in ambito sperimentale e creativo, è diventata rapidamente uno strumento potenzialmente pericoloso quando utilizzata per creare contenuti falsi ma credibili.

Il rischio principale dei deepfake non è solo la falsificazione dell’immagine, ma la sua capacità di influenzare la percezione pubblica della realtà.

Nel caso di figure politiche, il problema si amplifica, perché può incidere sulla fiducia dei cittadini, sull’opinione pubblica e sul dibattito democratico.

Il contesto politico e la reazione istituzionale

La vicenda ha immediatamente assunto una dimensione politica, con reazioni trasversali che hanno coinvolto maggioranza e opposizione.

Il tema della tutela dell’identità digitale e della reputazione delle persone pubbliche è diventato centrale nel dibattito parlamentare e mediatico.

Il caso Meloni evidenzia la necessità di aggiornare rapidamente il quadro normativo per affrontare i rischi legati all’intelligenza artificiale generativa.

In particolare, si discute sulla responsabilità delle piattaforme digitali e sulla necessità di strumenti più efficaci per individuare e rimuovere contenuti falsi.

“Sembro anche più bella”: la risposta della premier

Tra le reazioni attribuite alla presidente del Consiglio, ha fatto discutere una frase ironica legata alla vicenda, in cui avrebbe commentato la natura delle immagini false con una battuta sul proprio aspetto.

Una risposta che, pur nella sua leggerezza, sottolinea la consapevolezza della gravità del fenomeno e la volontà di non alimentare ulteriormente la polemica.

L’uso dell’ironia, in questo caso, si inserisce in una strategia comunicativa volta a ridimensionare l’impatto emotivo della vicenda, senza però sminuire il problema strutturale della manipolazione digitale.

Il problema della reputazione nell’era digitale

Il caso apre una riflessione più ampia sul concetto di reputazione nell’era dell’intelligenza artificiale.

Se in passato la reputazione era legata a fatti reali, dichiarazioni o comportamenti pubblici, oggi può essere influenzata anche da contenuti completamente artificiali.

La reputazione digitale è diventata un bene fragile, esposto a manipolazioni rapide e difficili da controllare.

Questo vale in particolare per le figure pubbliche, ma riguarda sempre più anche cittadini comuni, che possono diventare vittime inconsapevoli di contenuti falsificati.

Il ruolo delle piattaforme social

Uno degli aspetti più discussi riguarda il ruolo delle piattaforme digitali nella diffusione dei contenuti.

I social network rappresentano il principale canale attraverso cui immagini e video si diffondono rapidamente, spesso senza un controllo preventivo efficace.

La velocità di propagazione delle informazioni supera di gran lunga la capacità di verifica e moderazione dei contenuti.

Questo squilibrio crea un ambiente in cui i contenuti falsi possono raggiungere milioni di persone prima di essere rimossi o segnalati.

Intelligenza artificiale e nuove sfide normative

L’evoluzione dell’intelligenza artificiale generativa ha reso sempre più semplice la creazione di contenuti realistici ma falsi.

Negli ultimi anni, l’Unione Europea ha avviato un percorso normativo per regolamentare l’uso dell’IA, con particolare attenzione ai rischi legati alla manipolazione dell’informazione.

L’obiettivo è trovare un equilibrio tra innovazione tecnologica e tutela dei diritti fondamentali.

Il caso delle immagini false attribuite a figure pubbliche accelera ulteriormente questo dibattito, rendendo evidente la necessità di regole più chiare e strumenti di controllo più efficaci.

Il rischio della disinformazione visiva

A differenza delle fake news testuali, i contenuti visivi generati con IA hanno un impatto psicologico più immediato e potente.

Le immagini sono percepite dal cervello umano come prove dirette della realtà, rendendo più difficile metterne in dubbio l’autenticità.

Questo rende i deepfake uno strumento particolarmente insidioso nel panorama della disinformazione moderna.

Nel caso di figure politiche, il rischio è quello di influenzare l’opinione pubblica attraverso contenuti completamente falsi ma altamente persuasivi.

Il dibattito sulla responsabilità digitale

La vicenda ha riacceso il dibattito sulla responsabilità digitale, sia degli utenti sia delle piattaforme.

Chi crea contenuti falsi, chi li diffonde e chi li ospita online contribuisce, in modi diversi, alla loro circolazione.

La catena della responsabilità digitale è sempre più complessa e difficilmente riconducibile a un singolo attore.

Questo rende più difficile anche l’intervento delle autorità giudiziarie, che devono operare in un ambiente tecnologico in continua evoluzione.

Impatto politico e comunicativo del caso

Dal punto di vista politico, il caso assume un valore simbolico importante. Non riguarda solo la figura della premier, ma più in generale la vulnerabilità delle istituzioni nell’era digitale.

La manipolazione dell’immagine pubblica può avere conseguenze dirette sulla percezione dei leader politici e sulla fiducia dei cittadini.

La comunicazione politica diventa così sempre più esposta a rischi tecnologici che non esistevano fino a pochi anni fa.

L’effetto amplificatore dei social network

Uno degli elementi più critici è l’effetto amplificatore dei social network. Anche contenuti palesemente falsi possono diventare virali in poche ore.

La logica algoritmica premia l’engagement, non necessariamente la veridicità.

Questo meccanismo contribuisce alla rapida diffusione di contenuti manipolati o decontestualizzati.

La risposta delle istituzioni europee

L’Unione Europea sta lavorando a un quadro normativo più rigoroso per contrastare i rischi legati ai contenuti generati dall’intelligenza artificiale.

Tra le misure in discussione vi sono obblighi di trasparenza, etichettatura dei contenuti generati e maggiore responsabilità per le piattaforme digitali.

L’obiettivo è garantire che gli utenti possano distinguere chiaramente tra contenuti reali e artificiali.

Il confine tra satira, manipolazione e reato

Uno degli aspetti più complessi riguarda la distinzione tra satira, manipolazione e contenuti illeciti.

Non tutti i contenuti generati con IA sono illegali, ma diventano problematici quando violano la privacy, la dignità o la reputazione delle persone.

Il caso Meloni riporta l’attenzione sulla necessità di definire confini giuridici più chiari.

Il futuro della reputazione nell’era dell’IA

Il caso delle immagini false generate con intelligenza artificiale rappresenta solo uno dei primi episodi di una trasformazione più ampia.

Nel prossimo futuro, la gestione della reputazione personale e politica sarà sempre più legata alla capacità di controllare l’informazione digitale.

La sfida non è solo tecnologica, ma anche culturale e normativa.

La nuova frontiera della verità digitale

La vicenda che coinvolge Giorgia Meloni segna un ulteriore passo nell’evoluzione del rapporto tra politica, tecnologia e informazione.

Le immagini false generate con intelligenza artificiale non sono più un’ipotesi futuristica, ma una realtà concreta che incide sul dibattito pubblico e sulla percezione della verità.

Il caso evidenzia la necessità urgente di strumenti efficaci per proteggere l’identità digitale e garantire la trasparenza dell’informazione.

In un contesto in cui la realtà può essere replicata o alterata con pochi clic, la sfida principale diventa distinguere ciò che è vero da ciò che è costruito artificialmente.

© RIPRODUZIONE RISERVATA